Czy z komputerami będziemy się porozumiewać jak z ludźmi?

Pierwszy pecet IBM, wprowadzony w 1982 r., był w znacznym stopniu ułomny: nie mówił, nie słyszał, nie widział. Kontakt z użytkownikiem sprowadzał się do odczytywania komend wprowadzanych za pośrednictwem klawiatury i wyświetlania informacji na monochromatycznym monitorze. Komputer ma jednak coraz większe możliwości, jeśli chodzi o odbiór użytkownika i oddziaływanie na niego. Czy będziemy się z nim porozumiewać jak z człowiekiem? - Dziś termin "komputer" nadal kojarzy się nam z monitorem, klawiaturą i myszką. Wzajemna komunikacja prowadzona jest w nienaturalny sposób. Wyobraźmy sobie jednak świat, w którym używanie tego typu urządzeń będzie tak proste jak rozmowa z najbliższym przyjacielem. Pracujemy nad tym, by kontakt z komputerem stał się możliwy za pośrednictwem głosu bądź ruchów ręki - mówią naukowcy z firmy IBM, prowadzący projekt "Natural computing".

Elementy ułatwiające i urozmaicające dwustronną komunikację pojawiły się niemal natychmiast po premierze peceta. Szybko upowszechniły się myszki, karty graficzne generujące coraz więcej kolorów, a karty dźwiękowe zastąpiły piszczący głośniczek informujący wyłącznie o błędach (niektórzy potrafili wydobywać z niego melodie). Pierwszy znaczny przełom nastąpił na początku lat 90., gdy wprowadzono odtwarzacze CD-ROM. Płyty pozwoliły łatwo i tanio przenosić dużą ilość danych, na przykład rozbudowanej grafiki, animacji i dźwięku. Rozpoczęła się epoka multimediów. Trzy lata temu nastąpiła kolejna rewolucja, przedstawiana za pomocą skrótu 3D (three dimensions - trzy wymiary). Obraz i dźwięk stały się przestrzenne. - Najnowocześniejsze karty graficzne coraz bardziej zbliżają człowieka do wrażeń wizualnych, doznawanych przez niego na żywo. Filmy i obrazy, które jesteśmy w stanie stworzyć na komputerze, przestają się różnić od zapisanych na taśmie filmowej. Wirtualnych postaci już wkrótce niemal nie będzie można odróżnić od prawdziwych aktorów. Grafika komputerowa jest dziś najszybciej rozwijającą się gałęzią rynku PC. Możemy się więc niedługo spodziewać kolejnych niesamowitych dokonań w tej dziedzinie - zapowiada Marcin Kindler, dyrektor Creative Labs.

Elementy ułatwiające i urozmaicające dwustronną komunikację pojawiły się niemal natychmiast po premierze peceta. Szybko upowszechniły się myszki, karty graficzne generujące coraz więcej kolorów, a karty dźwiękowe zastąpiły piszczący głośniczek informujący wyłącznie o błędach (niektórzy potrafili wydobywać z niego melodie). Pierwszy znaczny przełom nastąpił na początku lat 90., gdy wprowadzono odtwarzacze CD-ROM. Płyty pozwoliły łatwo i tanio przenosić dużą ilość danych, na przykład rozbudowanej grafiki, animacji i dźwięku. Rozpoczęła się epoka multimediów. Trzy lata temu nastąpiła kolejna rewolucja, przedstawiana za pomocą skrótu 3D (three dimensions - trzy wymiary). Obraz i dźwięk stały się przestrzenne. - Najnowocześniejsze karty graficzne coraz bardziej zbliżają człowieka do wrażeń wizualnych, doznawanych przez niego na żywo. Filmy i obrazy, które jesteśmy w stanie stworzyć na komputerze, przestają się różnić od zapisanych na taśmie filmowej. Wirtualnych postaci już wkrótce niemal nie będzie można odróżnić od prawdziwych aktorów. Grafika komputerowa jest dziś najszybciej rozwijającą się gałęzią rynku PC. Możemy się więc niedługo spodziewać kolejnych niesamowitych dokonań w tej dziedzinie - zapowiada Marcin Kindler, dyrektor Creative Labs. Kolejnym etapem wydawało się wprowadzenie rzeczywistości wirtualnej (virtual reality). Pojawiły się specjalne hełmy z ciekłokrystalicznymi wyświetlaczami i żyroskopami. Te urządzenia pozwalają uzyskać niemal realistyczny obraz przestrzenny, a ruchy głowy powodują, że przesuwa się on w określonym kierunku. - Sprzedawaliśmy dwa lata temu hełmy VR. Wprawdzie zainstalowane w nich matryce LCD miały niską rozdzielczość, to niekiedy użytkownicy całkowicie odrywali się od rzeczywistości. Zgłaszały się do nas osoby, które urwały kabel, a nawet wyrwały obsługującą hełm kartę z komputera, gdyż... próbowały uciec przed goniącym je potworem. Urządzenia tej generacji były jednak bardzo drogie i często się psuły, dlatego przestaliśmy je sprzedawać - informuje Jakub Czechowicz z Veracompu. - Tymczasowo tanim substytutem hełmów VR mogą być okulary 3D - uważa Wojciech Kusowski z Ab. - Zastosowano w nich efekt stereoskopowy: z prędkością ok. 60 razy na sekundę wyświetlany jest na monitorze obraz na zmianę dla lewego i prawego oka. Dzięki temu użytkownik widzi w trzech wymiarach.

Polepsza się również percepcja obrazu przez komputer. Za pomocą skanera można wprowadzać do niego tekst i grafikę. Amatorski skaner kosztuje dziś niespełna 300 zł. Tyle trzeba zapłacić także za hit ostatnich miesięcy, czyli kamerę internetową. - W Polsce kamery na razie kupują przede wszystkim zafascynowani najnowocześniejszymi technikami lub osoby, które mają za granicą rodzinę. Zainteresowanie nimi na pewno będzie jednak coraz większe. Dzięki nim można na przykład tworzyć wideolisty (v-maile) i prowadzić na żywo wideokonferencje. Z czasem zapewne dołączane do komputera kamery zastąpią skanery (obecnie mają zbyt słabą rozdzielczość). Wystarczy wówczas pokazać przed nimi kartki, by całość szybko została wprowadzona do pamięci komputera. Problemem nie będzie również błyskawiczne wykonanie swojego zdjęcia - zapowiada Czechowicz. - Obraz z kamer rozmieszczonych w różnych ciekawych częściach globu (na przykład na krakowskim rynku i na Wawelu) coraz częściej można zobaczyć także za pośrednictwem Internetu. Niektóre serwisy pozwalają nawet samodzielnie kierować tymi urządzeniami: przesuwać oraz przybliżać lub oddalać obraz. W ten sposób możemy również podglądać z dowolnego miejsca na świecie, co się dzieje u nas w domu. Kamery firmy Logitech same powiadamiają właściciela - wysyłając list - że wykryły ruch w danym pomieszczeniu - dodaje.

Wprowadzenie obrazu do komputera to jednak dopiero pierwsza czynność służąca jego rozpoznaniu. - Najtrudniejsze jest wyodrębnianie konkretnych obiektów z obrazu i ich symboliczne opisanie, na przykład, że to jest drzewo, a to dom. Trzeba wziąć pod uwagę, iż są tysiące różnych domów, których wygląd zmienia się w zależności od kąta patrzenia czy oświetlenia. Jest to na tyle złożone zagadnienie, że jeszcze przez wiele lat nie zostanie opracowane komercyjne rozwiązanie. Niemniej prowadzone są badania nad robotami orientującymi się w otoczeniu i automatycznymi pilotami samochodowymi. Na razie znacznie lepiej sprawdzają się jednak na przykład czujniki odległości aniżeli kamery - twierdzi Cezary Dołęga z Neurosoftu.

- Analizę obrazu stosuje się w biometrii, czyli identyfikacji osób na podstawie ich cech biologicznych, na przykład wyglądu siatkówki bądź linii papilarnych. Biometria jest jednak ślepą uliczką, gdyż nie gwarantuje niezawodności. Do identyfikacji będą raczej wykorzystywane wszczepiane układy z podpisami cyfrowymi - uważa Dołęga. W miarę proste jest natomiast rozróżnianie obiektów statycznych i dynamicznych. Wykorzystuje to między innymi zestaw gier firmy Reality Fusion dołączanych do niektórych kamer internetowych (stojąc przed kamerą, możemy odbijać rękoma znajdującą się na ekranie piłkę). Z analizą obrazu powiązane jest także OCR (optical character recognition). - Rozpoznawanie pisma drukowanego nie sprawia już trudności, ale nie ma i prawdopodobnie nigdy nie uda się opracować systemów rozpoznających ciągłe pismo odręczne, choć już kilkadziesiąt lat pracuje się nad tym. Nie można się jednak temu specjalnie dziwić, gdyż także ludzie często nie są w stanie odczytać czyjegoś pisma, a niekiedy nawet własnego - zauważa właściciel Neurosoftu.

Bardziej zaawansowane są prace nad analizą i syntezą dźwięku. - Generowane przez syntezatory wypowiedzi stają się coraz bardziej ludzkie. Słysząc urządzenie używające języka angielskiego, nie można rozróżnić, czy mówi maszyna, czy człowiek. Wprawdzie język polski ma w miarę prostą morfologię, ale wciąż nie ma jego idealnego syntezatora. Nasz program SynTalk ciągle"mówi" trochę sztucznie, choć pracujemy już nad kolejną wersją. Mechanizm syntezy jest następujący: pobrany tekst dzielony jest na frazy, później na słowa, a następnie zamieniany jest na postać fonemiczną. Na ciąg fonemów nakłada się różne atrybuty prozodyczne (między innymi akcenty, melodyka), później zaczyna działać algorytm, który do-konuje zamiany na falę dźwiękową - opisuje Dołęga.

- Analiza mowy jest oczywiście bardziej złożona, choć zajmujące się tym systemy działają już w kilku językach. W polskim jest jednak ponad 1,5 mln haseł, czyli dziesięć razy więcej niż na przykład w angielskim. Pracujemy nad tym intensywnie, nie spodziewam się jednak, by analizator języka polskiego został opracowany wcześniej niż za dwa, trzy lata - uzupełnia.

- Udostępnia się coraz więcej produktów, w których wykorzystuje się technologię force feedback. Na razie są to przede wszystkim joysticki i kierownice dla graczy, drgające i stawiające opór zależnie od wykonywanych manewrów czy terenu, po którym się jedzie. Są już jednak także pierwsze poważniejsze zastosowania. Na targach Cebit firma Logitech zaprezentowała myszkę, dzięki której użytkownik czuje wypukłości strony, po której przesuwa się kursor. Łatwo jest więc zlokalizować przyciski - omawia oddziaływanie komputera na zmysł dotyku Jakub Czechowicz z Veracompu. - Na świecie powstają już elektroniczne nosy rozpoznające różne kompozycje gazów, na przykład przy użyciu sieci neuronowych. Trwają prace nad analizą i syntezą zapachu. Kwestią czasu jest więc to, jak przez Internet będą przesyłane próbki perfum - przewiduje Dołęga. - W przyszłości różne sensory będą "podpinane" bezpośrednio do mózgu i w ten sposób będzie można sterować systemem nerwowym człowieka, co pozwoli symulować dowolne doznania - podsumowuje. Wydaje się jednak, że poza zasięgiem komputerów na zawsze pozostanie szósty zmysł.

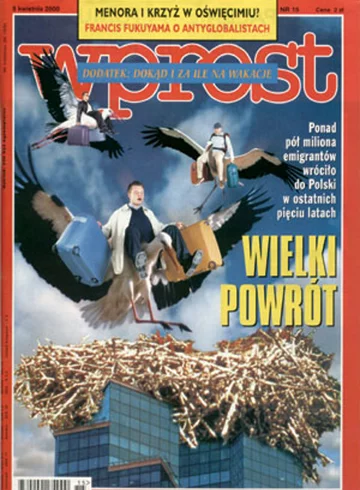

Więcej możesz przeczytać w 15/2000 wydaniu tygodnika Wprost .

Archiwalne wydania tygodnika Wprost dostępne są w specjalnej ofercie WPROST PREMIUM oraz we wszystkich e-kioskach i w aplikacjach mobilnych App Store i Google Play.